Die Diskussion um Datenschutz bei KI-Nutzung dreht sich meist um Cloud-Dienste wie ChatGPT oder Claude: Welche Daten dürfen eingegeben werden? Welche Verträge sind nötig? Und wohin wandern die Informationen? Dabei gerät eine dritte Option leicht aus dem Blick – eine, die inzwischen überraschend alltagstauglich ist: Künstliche Intelligenz, die vollständig auf dem eigenen Rechner läuft.

Was bedeutet „lokale KI“?

Bei klassischen KI-Diensten werden Eingaben an externe Server übertragen, dort verarbeitet und als Antwort zurückgesendet.

Lokale KI funktioniert anders: Das Sprachmodell läuft direkt auf dem eigenen Gerät. Die Daten verlassen den Rechner nicht – auch nicht verschlüsselt.

Datenschutzvorteile auf einen Blick

- Keine Datenübertragung ins Internet

- Keine Nutzung durch Dritte

- Kein Risiko geänderter Nutzungsbedingungen

- Kein Auftragsverarbeitungsvertrag nötig

Besonders sensibel arbeitende Stellen profitieren davon, etwa bei:

- Entwürfen für interne Dokumente

- Vorbereitungen von Bescheiden und Stellungnahmen

- Textanalysen ohne vorherige Anonymisierung

- Brainstorming in vertraulichen Themenfeldern

Natürlich ersetzt auch lokale KI nicht die Pflicht zu sorgfältigem Umgang mit personenbezogenen Daten – sie reduziert jedoch technische Risiken erheblich.

Welche Hardware wird benötigt?

Lokale KI-Modelle benötigen spürbare Rechenleistung. Ein gewöhnlicher Bürorechner reicht dafür in der Regel nicht aus. Entscheidend ist eine moderne Grafikkarte (GPU). In vielen Haushalten steht die passende Hardware bereits – oft ohne dass man es weiß. Ein Gaming-Computer, wie er häufig von Kindern oder Enkeln genutzt wird, erfüllt die Anforderungen meist problemlos. Grafikkarten wie die NVIDIA RTX 3060, 3070 oder 4060 bieten genau die Leistung, die lokale KI-Modelle benötigen, und machen den Einstieg damit wesentlich einfacher, als man vermuten würde.

Die technischen Anforderungen im Überblick

| Komponente | Minimum | Empfohlen |

|---|---|---|

| Grafikkarte (GPU) | NVIDIA mit 8 GB Speicher | NVIDIA mit 12+ GB Speicher |

| Arbeitsspeicher (RAM) | 16 GB | 32 GB |

| Festplatte | 20 GB frei (SSD empfohlen) | 50+ GB frei |

| Betriebssystem | Windows 10/11, macOS, Linux | – |

Und wenn keine Gaming-Grafikkarte vorhanden ist?

Lokale KI lässt sich grundsätzlich auch auf normalen Büro- oder Heimcomputern nutzen. Allerdings deutlich langsamer – statt 30–50 Wörtern pro Sekunde oft nur 3–5. Für erste Versuche ist das akzeptabel, für den Arbeitsalltag jedoch kaum praktikabel.

Gute Nachricht für Apple‑Nutzer

Moderne Macs mit M2-, M3- oder M4-Chips eignen sich überraschend gut für lokale KI. Ein MacBook Air M4 oder Mac Mini M4 bewältigt kleinere Modelle problemlos, während MacBook‑Pro-Geräte mit M4 Pro oder M4 Max sogar größere Modelle flüssig verarbeiten.

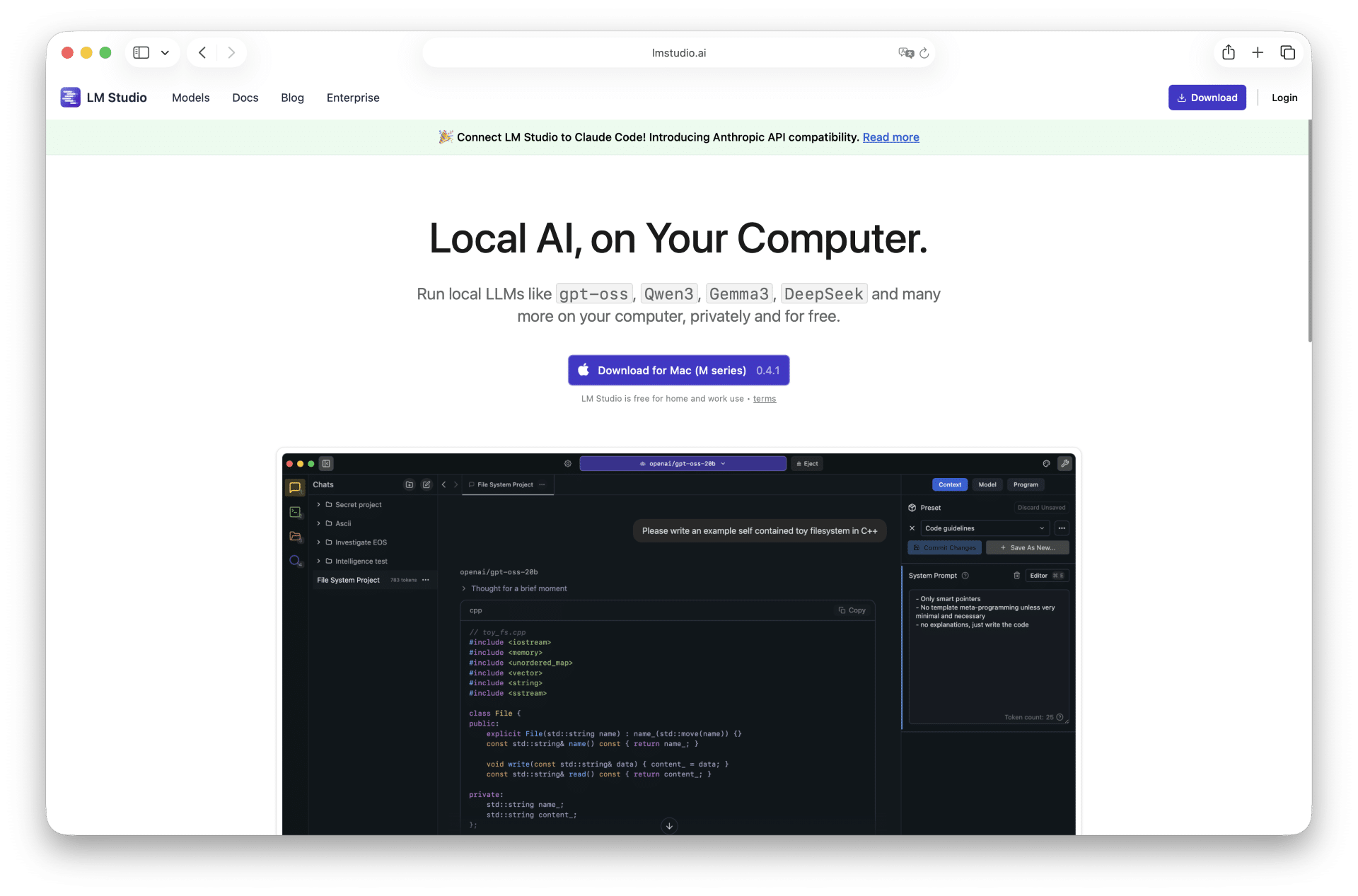

LM Studio: Der einfache Einstieg

Die Software, die lokale KI für Normalsterbliche zugänglich macht, heißt LM Studio. Sie ist kostenlos, läuft auf Windows, Mac und Linux, und kommt mit einer grafischen Oberfläche – keine Programmierung nötig.

Schritt 1: Download und Installation

- Öffnen Sie lmstudio.ai in Ihrem Browser

- Laden Sie die Version für Ihr Betriebssystem herunter (Windows, Mac oder Linux)

- Installieren Sie das Programm wie jede andere Software

Beim ersten Start fragt LM Studio, welchen Nutzer-Typ Sie bevorzugen. Wählen Sie „Power User“, das gibt Ihnen mehr nützliche Optionen.

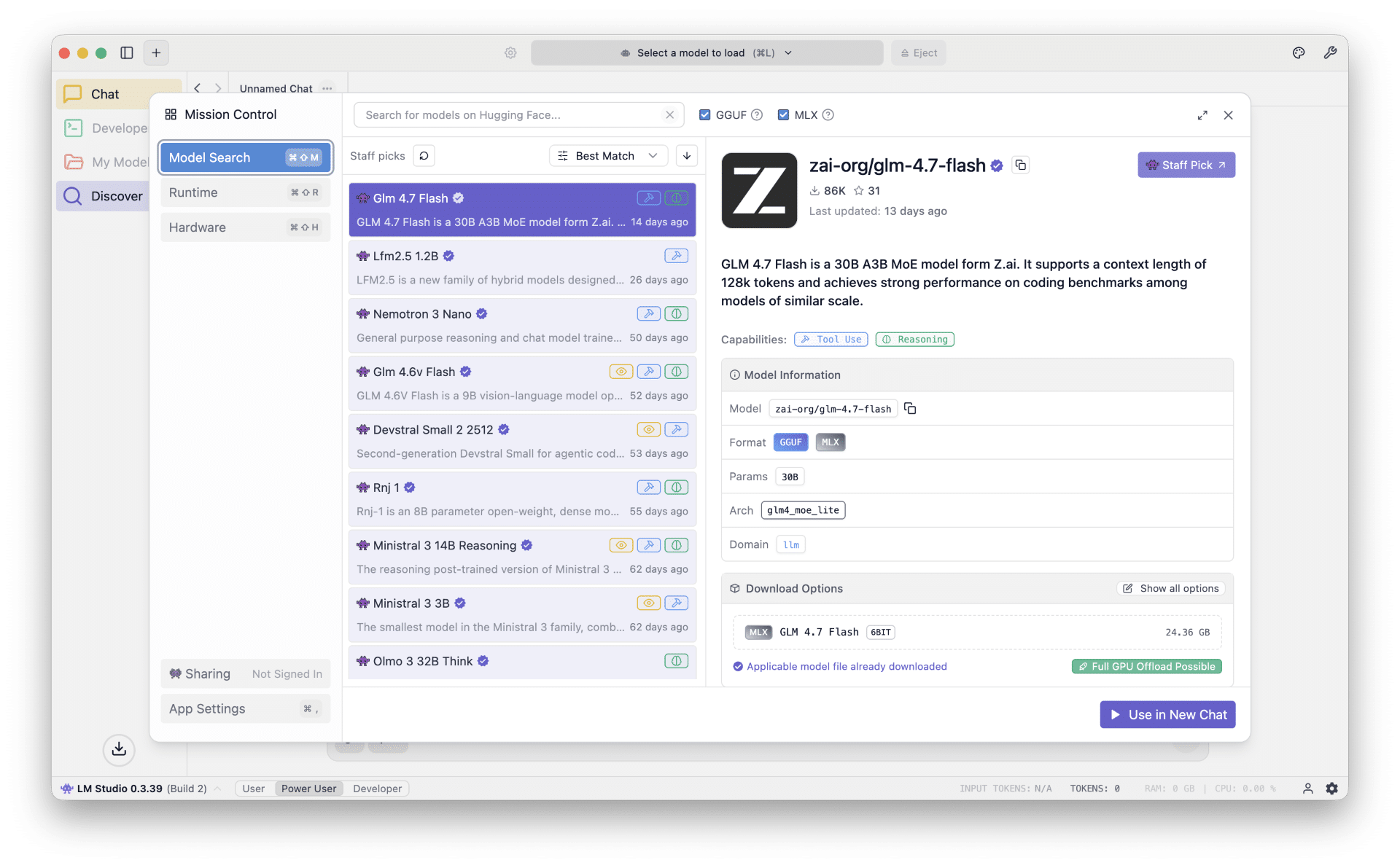

Schritt 2: Ein Modell herunterladen

- Klicken Sie auf die Lupe (Suche) in der linken Leiste

- Suchen Sie nach einem Modell, z.B. „Mistral 7B“ oder „Qwen3 8B“

- Wählen Sie eine Version mit „Q4“ im Namen (das ist eine komprimierte Version, die weniger Speicher braucht)

- Klicken Sie auf Download

Achtung: Die Modelle sind groß. Ein kleines Modell hat 4-5 GB, größere 10-30 GB. Der Download kann je nach Internetverbindung eine Weile dauern.

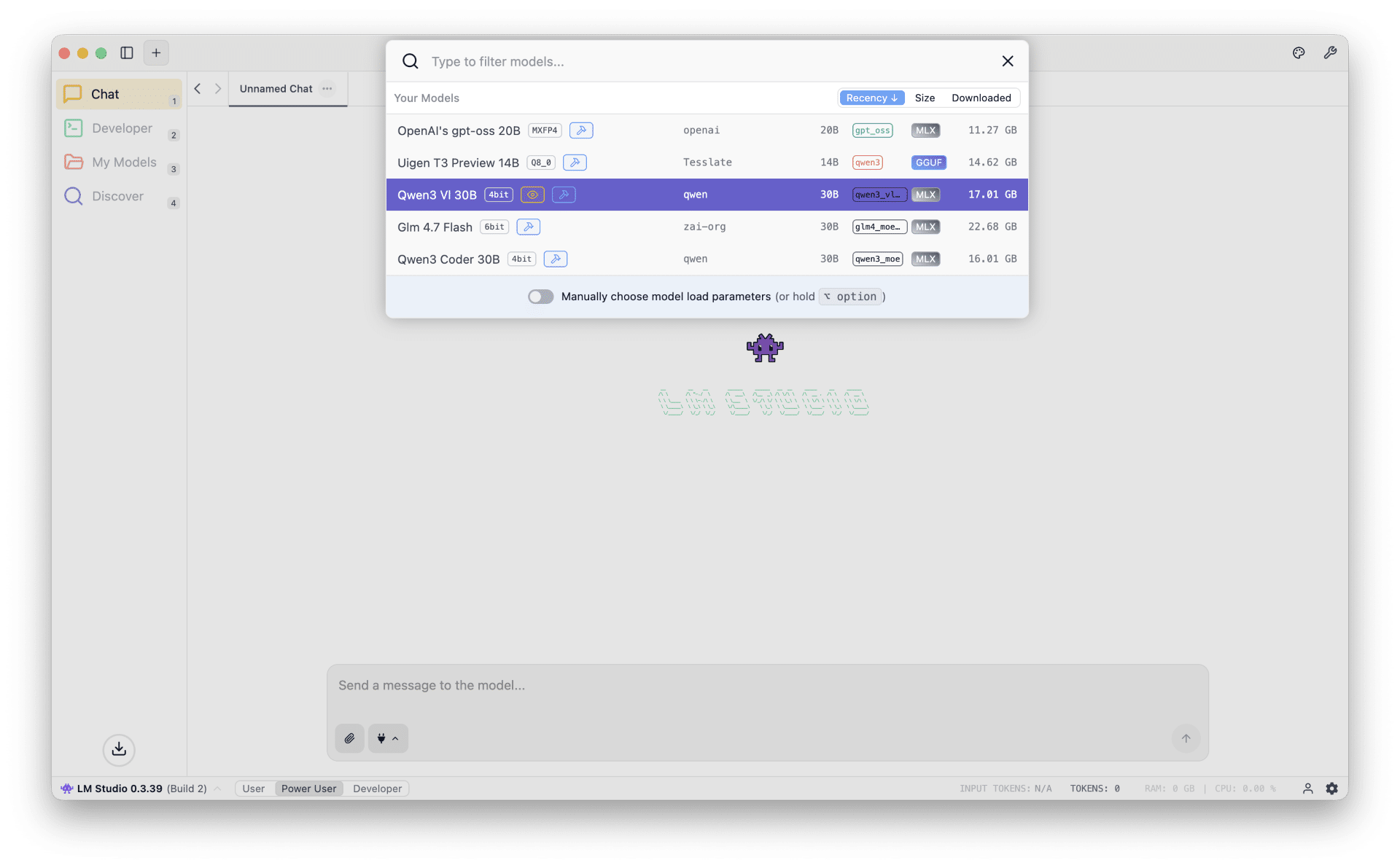

Schritt 3: Los geht’s – Ihr erster Chat

- Wechseln Sie zum Chat-Bereich (Sprechblase in der linken Leiste)

- Wählen Sie oben das heruntergeladene Modell aus

- Tippen Sie Ihre erste Frage ein – zum Beispiel: „Schreib mir eine höfliche Absage für eine Terminanfrage“

Die Antwort erscheint direkt – und sie wurde komplett auf Ihrem Rechner erzeugt. Kein Internet nötig, keine Daten unterwegs.

Wofür sind lokale Modelle geeignet?

Für wen lohnt sich lokale KI?

Kleine Hausaufgabe für diese Woche

Falls Sie zuhause einen Gaming-PC haben (oder jemanden kennen, der einen hat): Installieren Sie LM Studio und laden Sie ein kleines Modell herunter. Stellen Sie der KI eine einfache Frage aus Ihrem Arbeitsalltag – etwa „Formuliere eine höfliche Erinnerung an einen säumigen Antragsteller“. Vergleichen Sie das Ergebnis mit dem, was ChatGPT liefern würde.

Kein Gaming-PC vorhanden? Kein Problem. Dann ist die Hausaufgabe: Fragen Sie in Ihrer IT-Abteilung oder beim Gemeindeverband, ob lokale KI-Lösungen bereits ein Thema sind. Oft laufen im Hintergrund bereits Überlegungen, von denen man nichts mitbekommt.

– M.TREIBER (KIUMI – Die Agentur für Zusammenarbeit von KI und Mensch)

1

Der einfache und kostengünstige Einstieg für „Smart-Village“ Lösungen in Ihrer Gemeinde

2

Kommunalnet Service: Hameter Staudenshop & Beetplaner

3

kn-Vorteilsclub: Rauch Kühlsysteme

4

kn-Vorteilsclub: Gemeindefahnen

5

Gemeinde überwacht Wasserverbrauch von Haushalten und spart 100.000 Euro